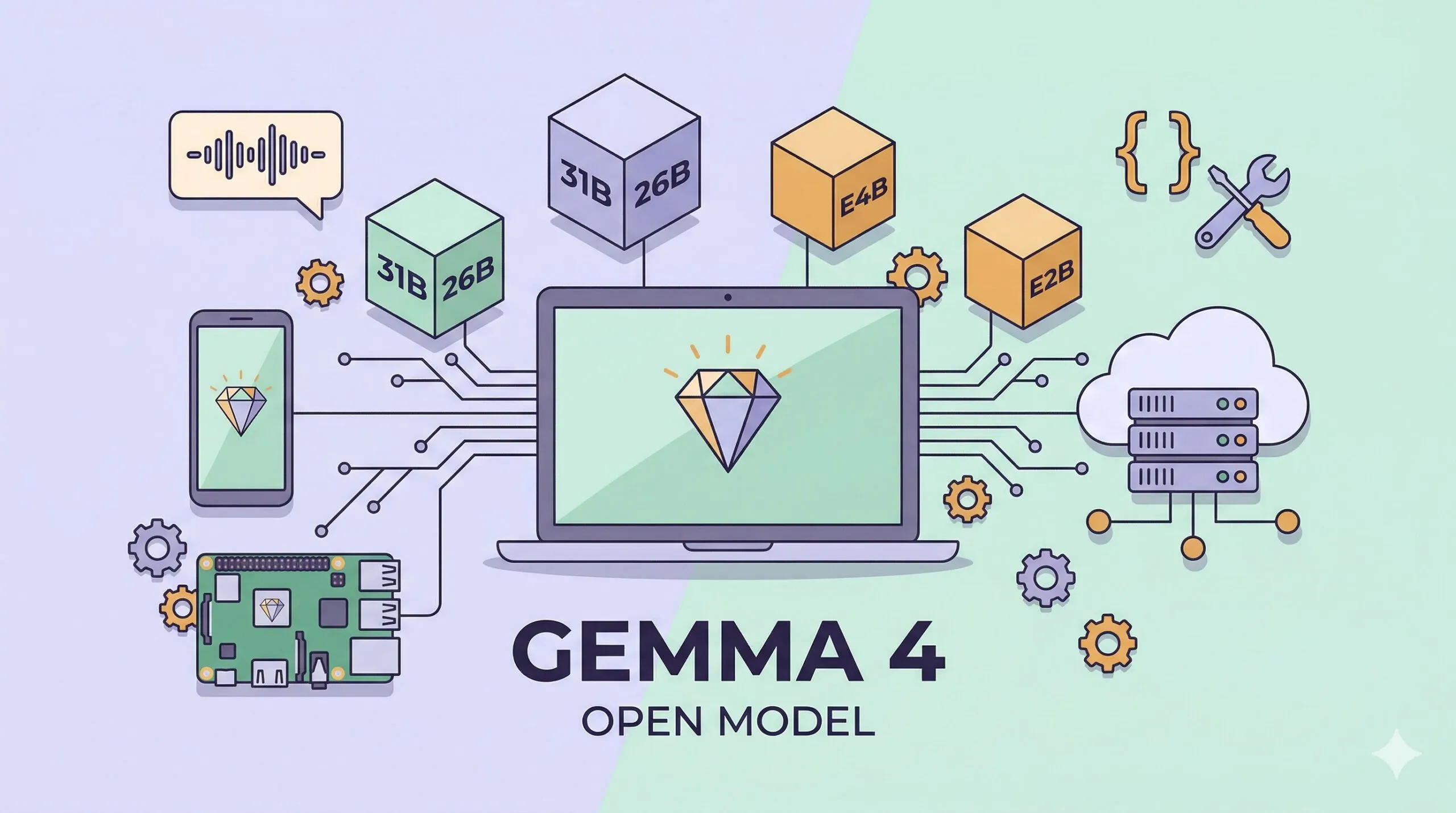

Google Gemma 4|マルチモーダル対応の Apache 2.0 オープンモデル、スマホでも 1.5GB で動く

オープンソース AI の競争はいよいよ激しくなってきました。Meta の Llama、Alibaba の Qwen、Mistral も新作を出し続け、DeepSeek もフロンティア勢に肉薄しつつあります。2026 年 4 月 2 日、Google DeepMind がそこに Gemma 4 を投入しました。Gemini 3 の研究成果から派生したオープンウェイトモデルファミリで、今回はライセンスが本当の意味で寛容な Apache 2.0 に切り替わっています。MAU 制限なし、追加の利用ポリシーもなし、引っかかりがありません。

謳い文句はストレートに「byte for byte, the most capable open models」。誇大広告ではありません。31B Dense は Arena AI のテキストリーダーボードでオープンモデル中 3 位、26B MoE 版はトークンごとに 3.8B しか起動しないにもかかわらず 6 位に入っています。最も小さい E2B は 1.5 GB 未満のメモリでマルチモーダル推論が走るため、スマートフォン、Raspberry Pi、ミドルレンジの IoT デバイスでも実用に乗ります。

本記事ではモデル構成、ベンチマーク、マルチモーダル対応、Agent Skills、そして実際に手元のハードウェアで動かす方法までを一通り紹介します。

Gemma 4 とは

Gemma は Google DeepMind が公開しているオープンウェイトのモデルファミリで、技術的には旗艦モデルである Gemini 系列の派生にあたります。前世代の Gemma 3 は 2025 年に登場して好評を得ていましたが、今回の Gemma 4 はそれをさらに進めて、Gemini 3 の研究をベースにアーキテクチャと学習プロセスに大幅な改善を加えています。

リリースは4 サイズを一気に展開しており、ノート PC・ワークステーションからスマートフォンまでをカバーします。

- 31B Dense — フル 31B パラメータの密モデル。最高品質。最大の推論能力が必要な用途向け。

- 26B A4B MoE — 総パラメータ 26B、トークンごとに起動するのは 3.8B だけ。Mixture of Experts により 31B にかなり近い品質を、はるかに低い推論コストで実現。

- E4B — 「E」は Effective(有効パラメータ)の頭文字。総パラメータは embedding を含めて 8B、有効パラメータは 4.5B。エッジ向けのミドルレンジ。

- E2B — 総 5.1B、有効 2.3B。最軽量で、まさに 1.5 GB に収まるサイズ。IoT・スマートフォン向けの本命。

すべてのサイズに base と instruction-tuned (IT) の 2 系統があり、重みは Hugging Face・Kaggle・Ollama ライブラリから入手できます。

仕様一覧

| モデル | 有効パラメータ | 総パラメータ | 層数 | コンテキスト長 | 対応モダリティ |

|---|---|---|---|---|---|

| E2B | 2.3B | 5.1B | 35 | 128K | テキスト・画像・音声 |

| E4B | 4.5B | 8B | 42 | 128K | テキスト・画像・音声 |

| 26B A4B MoE | 3.8B(起動時) | 26B | — | 256K | テキスト・画像・動画 |

| 31B Dense | 31B | 31B | 60 | 256K | テキスト・画像・動画 |

注目すべきアーキテクチャ上の工夫がいくつかあります。

- Per-Layer Embeddings (PLE) — 各層に独自の embedding 注入を持たせ、メインの residual stream と並走する条件付け経路を増設。マルチモーダル入力をきれいに扱える設計。

- Shared KV Cache — 後続の層が前段の Key/Value テンソルを再利用することで、長文推論時のメモリと計算量を大幅に削減。

- ハイブリッド注意機構 — sliding window の局所注意と、コンテキスト全体を見るグローバル注意を交互に使い、効率と表現力のバランスを取る。

- 可変な画像トークン予算 — 1 枚の画像に 70〜1,120 トークンを割り当てられ、速度と精度を自由に天秤にかけられる。

ベンチマーク

目立つ数字から見ていきます。Arena AI のテキストリーダーボードで、31B Dense は 1452 Elo でオープンモデル中 3 位、26B A4B MoE は 1441 Elo で 6 位。後者はトークンごとに 3.8B しか動かしていないことを思い出してください。

下は前世代 Gemma 3 27B との詳細比較です。

推論と知識

| Benchmark | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B |

|---|---|---|---|---|---|

| MMLU Pro | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| BigBench Hard | 74.4% | 64.8% | 33.1% | 21.9% | 19.3% |

Gemma 4 31B は AIME 2026 で 89.2% を記録、Gemma 3 27B の 20.8% から 4 倍以上のスコアです。最小の E2B(有効 2.3B)でも GPQA Diamond で Gemma 3 27B と並んでいます。

コード

| Benchmark | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B |

|---|---|---|---|---|

| LiveCodeBench v6 | 80.0% | 77.1% | 52.0% | 44.0% |

| Codeforces Elo | 2150 | 1718 | 940 | 633 |

ビジョン

| Benchmark | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B |

|---|---|---|---|---|

| MMMU Pro | 76.9% | 73.8% | 52.6% | 44.2% |

| MATH-Vision | 85.6% | 82.4% | 59.5% | 52.4% |

マルチモーダル対応

Gemma 4 は全サイズがマルチモーダル対応ですが、サイズによって使えるモダリティが少し異なります。

- 画像理解(全サイズ)— 可変なアスペクト比と解像度に対応、無理に正方形に切り抜く必要なし。物体検出、キャプション、OCR、グラフ解析などに使える。

- 動画理解(31B、26B A4B)— マルチフレーム解析、最長 60 秒のクリップに対応。

- 音声処理(E2B、E4B)— USM スタイルの Conformer エンコーダ、音声認識と音声 Q&A に対応、最大 30 秒のオーディオを 1 リクエストで処理可能。

- 多言語— 事前学習は 140+ 言語、post-training は 35+ 言語をカバー。

設計として面白いのは、大きいモデル(31B、26B)が動画に対応する一方で音声は持たず、小さいエッジモデル(E2B、E4B)は逆に音声に対応するが動画は持たない、という非対称です。エッジ側ではキラーアプリが音声インタラクションになりがちで、大きい側はビジュアル文書やクリップ処理のような用途が多いから、という事情でしょう。

エージェント能力と Function Calling

エージェント的なワークフローは今回のリリースの主要テーマです。Gemma 4 はネイティブで以下に対応しています。

- Function calling — ツールを定義しておけば、モデルが呼び出すべきタイミングを自分で判断し、適切なフォーマットで呼び出しリクエストを生成。

- 構造化 JSON 出力 — grammar constraint や後処理なしで、有効な JSON を直接出力。

- 多段の推論と計画 — 複雑なゴールを順序立てたステップに分解して実行。

- System instructions — エージェントの振る舞いやガードレールを定義する仕組みをファーストクラスでサポート。

- Extended thinking — 最大 4,000 トークンの「もう少し考える」モードで、難しい問題に対応。

Google はあわせて Agent Skills という新しい概念を打ち出しました。再利用可能な能力バンドルで、開発者がエッジ上で完全にオフラインの自律ワークフローを構築できるようにします。ナレッジベースの拡張、インタラクティブなコンテンツ生成、他モデルとの連結などを、すべてデバイス内・ネット接続なしで実現する想定です。

実際にエッジで動かす

Gemma 4 で個人的に一番おもしろいのはエッジ部分です。2-bit / 4-bit 量子化を使えば、E2B は 1.5 GB 未満のメモリで動きます。最近のスマートフォンであれば Android でも iPhone でもほぼ動かせるサイズです。

リリースから抜粋した数字をいくつか。

- Raspberry Pi 5 で E2B:prefill 約 133 tokens/s、decode 約 7.6 tokens/s。

- GPU アクセラレーションありで、4,000 入力トークン + 2 つの Agent Skill を 3 秒以内で処理。

- 前世代比で速度 4 倍、消費電力 60% 削減。

対応プラットフォームは Android・iOS・Windows・Linux・macOS(Metal 対応)・WebGPU ブラウザ・Raspberry Pi・Qualcomm QC8 NPU。Google・MediaTek・Qualcomm の最新世代 AI アクセラレータ向けにハードウェア最適化済みのパスも用意されています。

Gemma 4 を動かす方法

入口はたくさんあります。手持ちのハードウェアに合うものを選んでください。

スマートフォンで動かす

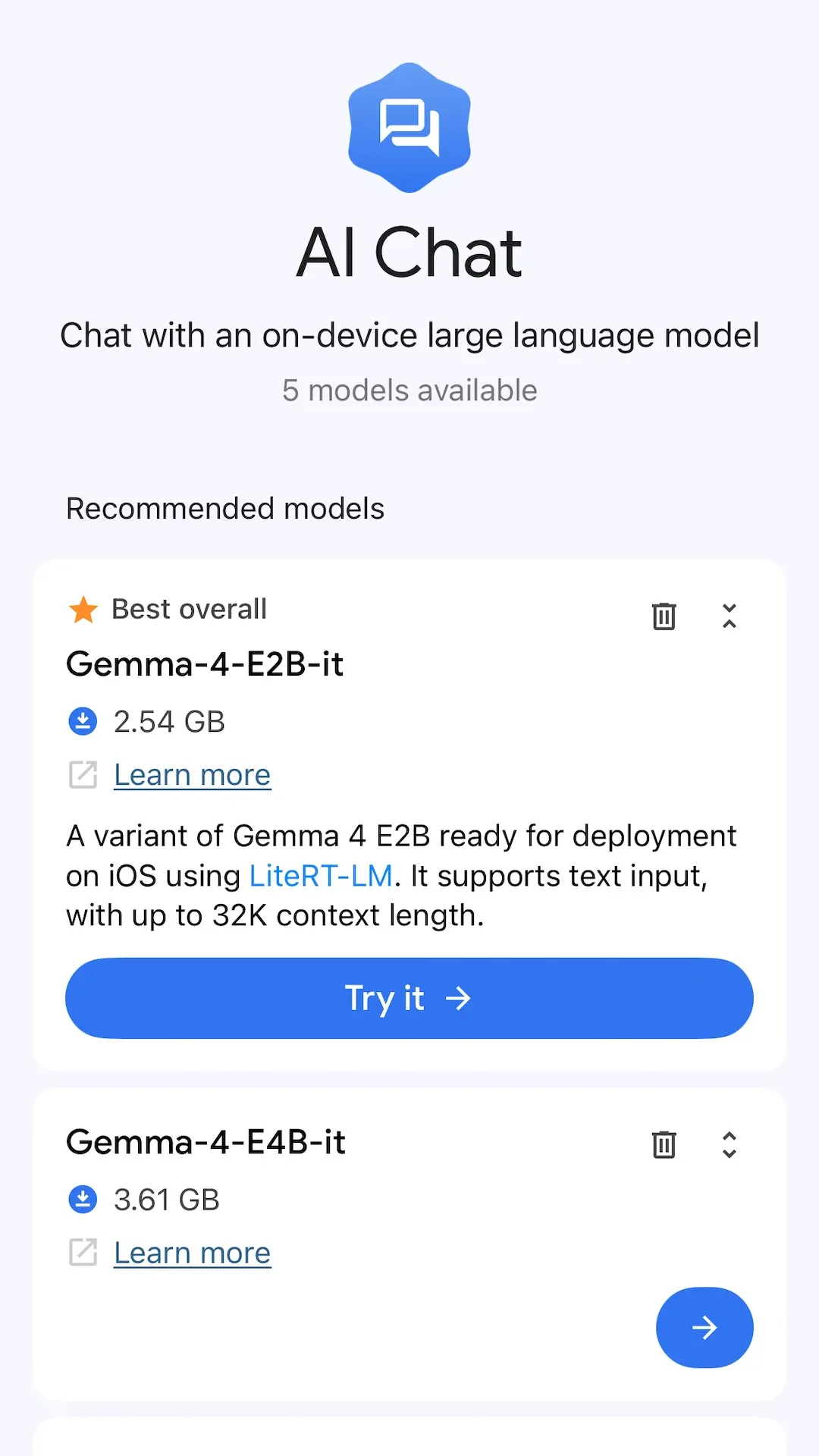

スマートフォンで Gemma 4 を試す最短ルートは Google AI Edge Gallery アプリです。Android は Google Play、iOS は App Store で配布されています。E2B または E4B をデバイスにダウンロードすれば、すべてオフラインで動きます。コードを書く必要はありません。

Android 開発者にはもう一つ選択肢があります。AICore Developer Preview です。これは Android のシステムレベルのオンデバイス AI サービスで、アプリは API を呼び出すだけで Gemma 4 を共有ランタイム上で動かせます。重要なのは、E2B と E4B は将来の Gemini Nano 4 の基盤モデルでもあるという点で、今 Gemma 4 向けに書いたコードは、後の Gemini Nano 4 搭載デバイス上でも修正なしで動きます。

iPhone では AI Edge Gallery 以外に、llama.cpp の iOS ビルドや Core ML 対応のツールチェーンを使ってデプロイすることもできます。E2B は 1.5 GB しか食わないので、ここ数年の iPhone なら十分余裕があります。

もう 1 つ、覚えておく価値のある細かい話があります。同じ E4B モデルでも、AI Edge Gallery では 3.61 GB、Ollama では 9.6 GB とサイズに 3 倍近い差があります。これはフォーマットと量子化精度の違いによるものです。AI Edge Gallery は Google 自前の LiteRT(旧 TFLite)を使い、モバイル GPU/NPU に最適化された 4-bit 量子化を積極的に使っています。一方の Ollama は GGUF を使い、デスクトップ CPU や Apple Silicon を想定して、デフォルトでより高精度の量子化(通常は Q4_K_M 以上)を採用します。モバイル版は品質を少し落として小さいサイズと低い RAM 使用量を取り、デスクトップ版はディスク容量と引き換えにモデルのディテールをより多く残しています。

Ollama

ローカルで初めて LLM を動かすなら、まず Ollama 入門ガイドでランタイムを入れてください。あとは 1 行で任意のサイズが起動します。

# E2B — 最軽量、ノート PC やスマホ向け

ollama run gemma4:e2b

# E4B

ollama run gemma4:e4b

# 26B MoE — RAM は要るが推論が速い

ollama run gemma4:26b

# 31B Dense — 最高品質、もっとも重い

ollama run gemma4:31b詳細は ollama.com/library/gemma4。

llama.cpp

より細かく制御したい場合は llama.cpp + GGUF 量子化が向きます。

# macOS インストール

brew install llama.cpp

# OpenAI 互換 API サーバーを起動

llama-server -hf ggml-org/gemma-4-E2B-it-GGUF

# 量子化レベルを指定(Q4_K_M がスイートスポット)

llama-server -hf ggml-org/gemma-4-26b-a4b-it-GGUF:Q4_K_MMLX(Apple Silicon)

Mac ユーザーは Apple 自家製の MLX フレームワークを使えます。M シリーズチップ専用にチューニングされています。

# mlx-vlm をインストール

pip install -U mlx-vlm

# マルチモーダル推論(画像 + テキスト)

mlx_vlm.generate \

--model google/gemma-4-E4B-it \

--image photo.jpg \

--prompt "Describe this image"

# TurboQuant で KV キャッシュをおおむね 4 倍節約

mlx_vlm.generate \

--model mlx-community/gemma-4-26B-A4B-it \

--prompt "Explain quantum computing" \

--kv-bits 3.5 \

--kv-quant-scheme turboquantGoogle AI Studio

ローカルで動かしたくないなら、31B と 26B MoE は Google AI Studio でホストされています。ダウンロード不要、サイトを開けばすぐ使えます。E2B と E4B は Google AI Edge Gallery で試せます。

Hugging Face transformers

Python 開発者は transformers から直接ロードできます。

from transformers import pipeline

# pipeline でクイックスタート

pipe = pipeline("any-to-any", model="google/gemma-4-e2b-it")

messages = [

{

"role": "user",

"content": [

{"type": "image", "image": "photo.jpg"},

{"type": "text", "text": "What is in this image?"},

],

}

]

output = pipe(messages, max_new_tokens=200)

print(output)Apache 2.0 — 本当の意味でのオープンソース

ライセンスの変更はあらためて取り上げる価値があります。Gemma 3 は Google 独自の Gemma Terms of Use で、無料ですがいくつかの制限がありました。Gemma 4 は Apache 2.0 に切り替わり、次のような扱いになります。

- 月間アクティブユーザー(MAU)の上限なし。

- 追加の利用ポリシー的な縛りなし。

- 完全な商用利用の自由。

- 自由に修正・フォーク・再配布可能。

これにより Gemma 4 は Mistral(同じく Apache 2.0)と同じ土俵に並び、Meta の Llama(独自ライセンス、7 億 MAU の上限あり)よりむしろ寛容といえます。Llama の MAU 条項を理由に採用を見送ってきた企業にとっては、ハードルが 1 つ取り除かれた格好です。

まとめ

Gemma 4 はオープンウェイトの世界に大きな存在感を持ち込みました。31B と 26B MoE はトップクラスのオープンモデルと推論能力で正面から競争でき、E2B と E4B はマルチモーダル AI をスマートフォンや IoT デバイスにまで届けます。Apache 2.0 ライセンス、ネイティブのエージェントツーリング、140+ 言語のカバレッジを合わせると、チャットボット・RAG・コード生成・Android アプリへの組み込みまで、何を作るにしても本気で検討する価値のあるモデルファミリです。

まだローカルでオープンモデルを動かしたことがなければ、まずは Ollama 入門ガイドから始めてみてください。Ollama を入れたら ollama run gemma4:e2b を 1 行打つだけです。

参考資料

- Gemma 4: Byte for byte, the most capable open models — Google 公式アナウンス

- Gemma 4 — Google DeepMind — DeepMind モデルページ

- Gemma 4 Model Card — 公式仕様とベンチマーク

- Bring state-of-the-art agentic skills to the edge with Gemma 4 — Google Developers Blog、エッジデプロイの詳細

- Gemma 4: The new standard for local agentic intelligence on Android — Android Developers Blog

- Announcing Gemma 4 in the AICore Developer Preview — AICore Developer Preview 告知

- Welcome Gemma 4: Frontier multimodal intelligence on device — Hugging Face による技術解説

- Google announces open Gemma 4 model with Apache 2.0 license — 9to5Google による報道